AI企業のAnthropicは、自社の対話型AI「Claude」が過度にユーザーを肯定する「ごますり(Sycophancy)」応答をどのような状況で行うかを調査した研究結果を公開した。100万件の会話をプライバシーに配慮した手法でサンプリングしたところ、約6%がユーザーが個人的なアドバイスを求める会話であることが判明した。

個人的なアドバイスを求める会話の内訳を見ると、健康・ウェルネスが約27%、仕事・キャリアが約26%、人間関係が約12%、資産運用が約11%と、この4分野で全体の約76%を占めていた。こうした相談の中で、ごますり行動が含まれていた会話は全体の約9%だったが、人間関係に関する会話では約25%と特に高い割合を示した。また、スピリチュアルに関する会話では約38%という高い発生率が確認されている。

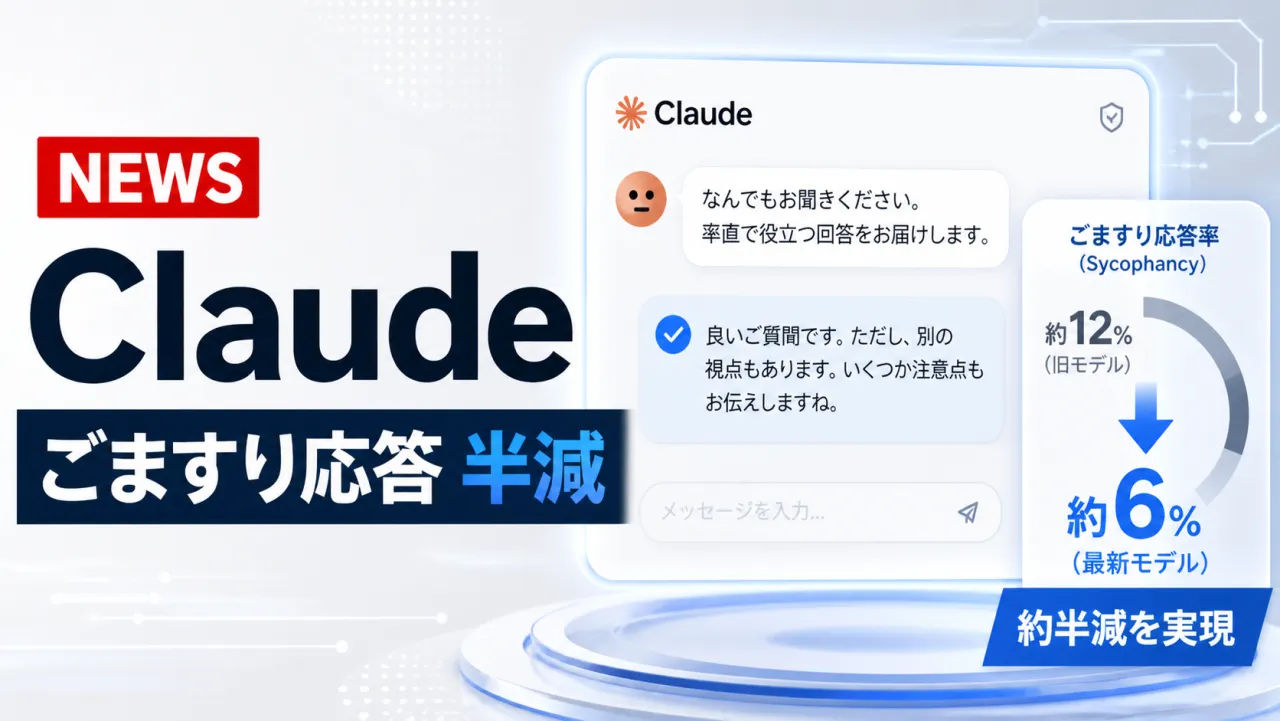

Anthropicはこの問題を重視し、ごますり行動が多く見られた状況を分析して人間関係に関する合成トレーニングデータを作成。これを最新モデルの「Claude Opus 4.7」および「Claude Mythos Preview」の学習に活用した。その結果、Opus 4.7では人間関係ガイダンスにおけるごますり率が旧モデル比で約半減したほか、他のカテゴリ全般にも改善効果が波及したという。

Anthropicは「Claudeを正直でユーザーの自律性を維持するエージェントにする」という方針を掲げており、AIが無批判にユーザーの判断を肯定することで生じるリスク、例えば無計画な転職や誤った意思決定を後押ししてしまう事態を防ぐことを目指している。ごますり行動の抑制は、AIが人間の重要な選択に関わる機会が増える中で、信頼性の高いアシスタントを実現するうえで重要な課題とされている。

出典:https://www.anthropic.com/research/claude-personal-guidance

管理人コメント

「その判断、完璧です!」って言ってほしいときに限って正直に返してくるやつ。でもよく考えたら、ゲームでも「今の動きサイコー!」って言ってくれるAIコーチより、「そのルートは死ぬぞ」って教えてくれるほうが100倍ありがたいですよね。ごますりAIより正直AIの時代、来てます。

読み込み中...